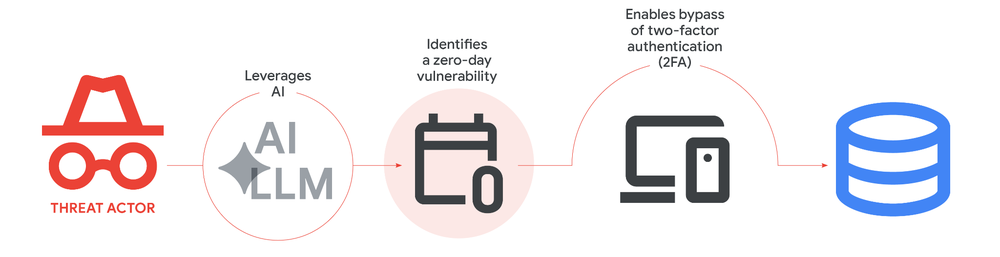

Los ciberdelincuentes utilizaron inteligencia artificial para crear un exploit de día cero funcional

El Grupo de Inteligencia sobre Amenazas de Google anunció el domingo que detectó lo que cree que es la primera vulnerabilidad de día cero creada con la ayuda de un modelo de inteligencia artificial.

Según un informe publicado por Google en su blog de la nube, un grupo de hackers criminales creó un script de Python para eludir la autenticación de dos factores (2FA) en una herramienta de administración web de código abierto. La compañía colaboró con el proveedor para detener la explotación masiva antes de que comenzara.

Google vinculó la vulnerabilidad con la IA a través de patrones de código

Google no culpó a su propio modelo Gemini. Los analistas señalaron patrones estructurales en el código que sugierentronla participación de la IA.

“Basándonos en la estructura y el contenido de estos exploits, tenemos una alta probabilidad de que el atacante haya utilizado un modelo de IA para descubrir y explotar esta vulnerabilidad”, escribió.

El script de Python contenía cadenas de documentación educativas inusualmente detalladas, una puntuación de gravedad CVSS ilusoria y un formato típico de la salida de modelos de lenguaje de gran tamaño.

Esto incluye menús de ayuda estructurados y una clasificación de colores clara, redactada al estilo de un libro de texto.

Google no ha revelado el nombre del grupo de hackers ni la herramienta específica que fue atacada.

Hackers respaldados por el Estado utilizan modelos de IA para la investigación de vulnerabilidades

El informe de Google va más allá del único caso de vulnerabilidad de día cero.

Según el Grupo de Inteligencia de Amenazas de Google, los hackers vinculados a China y Corea del Norte han mostrado untroninterés en utilizar la IA para encontrar y aprovechar fallos de software.

Un grupo de ciberdelincuentes chino conocido como UNC2814 ataca objetivos gubernamentales y de telecomunicaciones. El grupo utilizó una técnica que Google denomina jailbreaking basado en perfiles de usuario.

El grupo instruyó a un modelo de IA para que actuara como un auditor de seguridad sénior y, posteriormente, le ordenó analizar el firmware de dispositivos integrados de implementaciones del Protocolo de Transferencia de Archivos (FTTP) de TP-Link y Odette en busca de vulnerabilidades de ejecución remota de código.

El grupo puso en marcha un modelo de IA para que actuara como auditor de seguridad sénior y, a continuación, le ordenó que buscara vulnerabilidades de ejecución remota de código en el firmware de los dispositivos integrados de TP-Link y en las implementaciones del protocolo de transferencia de archivos Odette.

Otro grupo, vinculado a China, utilizó herramientas llamadas Strix y Hexstrike para atacar a una empresa tecnológica japonesa y a una importante compañía de ciberseguridad del este de Asia.

El grupo norcoreano APT45 adoptó un enfoque diferente. Envió miles de mensajes repetitivos para analizar recursivamente las entradas CVE conocidas y validar las pruebas de concepto de las vulnerabilidades.

Google afirmó que este método generó "un arsenal más robusto de capacidades de explotación que sería impracticable gestionar sin la ayuda de la IA"

La IA permite nuevas formas de malware y evasión

El informe de Google abarca otras amenazas a la IA más allá de la investigación de vulnerabilidades.

Se sospecha que piratas informáticos rusos han utilizado inteligencia artificial para programar y crear malware polimórfico y redes de ofuscación. Este malware acelera los ciclos de desarrollo y les ayuda a evadir la detección.

Google también advirtió sobre un tipo de malware que denomina PROMPTSPY, el cual describe como un cambio hacia operaciones de ataque autónomas. Este malware utiliza modelos de IA para interpretar los estados del sistema y generar comandos dinámicamente para manipular los entornos de las víctimas. Los atacantes pueden delegar las decisiones operativas al propio modelo.

Actualmente, los ciberdelincuentes obtienen acceso anónimo de nivel premium a modelos de lenguaje mediante software intermedio especializado y sistemas automatizados de registro de cuentas. Estos servicios permiten a los hackers eludir masivamente las restricciones de uso, utilizando cuentas de prueba para financiar sus actividades.

Un grupo que Google traccomo TeamPCP, también conocido como UNC6780, ha comenzado a atacar las dependencias de software de IA como punto de entrada a redes más amplias. Utilizan herramientas de IA comprometidas como base para el despliegue de ransomware y la extorsión.

Google afirmó que utiliza sus propias herramientas de IA con fines defensivos. La compañía mencionó Big Sleep, un agente de IA que identificadentde software, y CodeMender, que utiliza el razonamiento de Gemini paramaticlos fallos.

Google también afirmó que desactiva las cuentas que sean sorprendidas utilizando Gemini de forma indebida con fines maliciosos.

No te limites a leer noticias sobre criptomonedas. Entiéndelas. Suscríbete a nuestro boletín. Es gratis.