Hackers criminosos usaram IA para escrever um exploit zero-day funcional

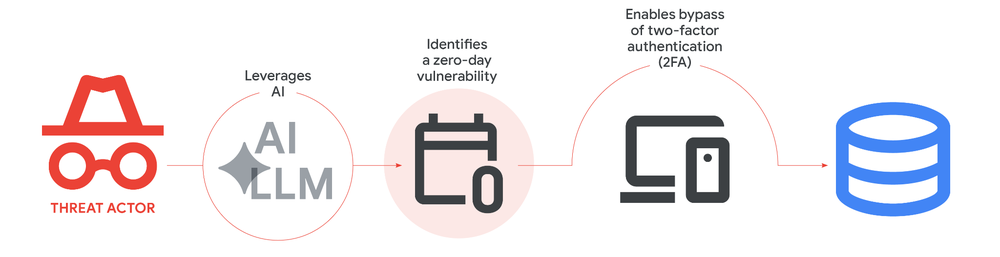

O Grupo de Inteligência de Ameaças do Google afirmou no domingo ter detectado o que acredita ser a primeira vulnerabilidade zero-day explorada com a ajuda de um modelo de IA.

Um grupo criminoso de hackers criou um script em Python para burlar a autenticação de dois fatores (2FA) em uma ferramenta de administração web de código aberto, de acordo com um relatório publicado pelo Google em seu blog na nuvem. A empresa trabalhou com o fornecedor para impedir a exploração em massa antes que ela começasse.

O Google associou a exploração à IA por meio de padrões de código

O Google não culpou seu próprio modelo Gemini. Analistas apontaram para padrões estruturais no código que sugeremtrono envolvimento de IA.

“Com base na estrutura e no conteúdo dessas explorações, temos grande confiança de que o agente provavelmente utilizou um modelo de IA para auxiliar na descoberta e na exploração dessa vulnerabilidade”, escreveu.

O script em Python tinha docstrings educacionais excepcionalmente detalhadas, uma pontuação de gravidade CVSS alucinatória e uma formatação típica da saída de grandes modelos de linguagem.

Isso inclui menus de ajuda estruturados e uma classe de cores clara, escrita em estilo didático.

O Google não divulgou o nome do grupo de hackers nem a ferramenta específica que foi alvo do ataque.

Hackers patrocinados pelo Estado usam modelos de IA para pesquisa de vulnerabilidades

O relatório do Google vai além do caso isolado de vulnerabilidade zero-day.

Hackers ligados à China e à Coreia do Norte demonstraramtroninteresse em usar inteligência artificial para encontrar e explorar falhas de software, de acordo com o Grupo de Inteligência de Ameaças do Google.

Um grupo de ameaças cibernéticas chinês conhecido como UNC2814 ataca alvos governamentais e de telecomunicações. O grupo utiliza uma técnica que o Google chama de jailbreak baseado em persona.

O grupo instruiu um modelo de IA a se comportar como um auditor de segurança sênior e, em seguida, o direcionou para analisar o firmware de dispositivos embarcados das implementações do Protocolo de Transferência de Arquivos (FTP) da TP-Link e da Odette em busca de vulnerabilidades de execução remota de código.

O grupo instruiu um modelo de IA a atuar como um auditor de segurança sênior e, em seguida, o direcionou para pesquisar vulnerabilidades de execução remota de código no firmware de dispositivos embarcados da TP-Link e nas implementações do Protocolo de Transferência de Arquivos Odette.

Um grupo diferente, com ligações à China, utilizou ferramentas chamadas Strix e Hexstrike para atacar uma empresa de tecnologia japonesa e uma importante empresa de cibersegurança do Leste Asiático.

O grupo norte-coreano APT45 adotou uma abordagem diferente. Enviou milhares de solicitações repetitivas para analisar recursivamente entradas CVE conhecidas e validar exploits de prova de conceito.

O Google afirmou que esse método produziu "um arsenal mais robusto de recursos de exploração que seriam impraticáveis de gerenciar sem a ajuda da IA"

A IA possibilita novas formas de malware e evasão

O relatório do Google aborda outras ameaças da IA além da pesquisa de vulnerabilidades.

Suspeitos de serem hackers russos usaram inteligência artificial para codificar e construir malware polimórfico e redes de ofuscação. Esse malware acelera os ciclos de desenvolvimento e os ajuda a evitar a detecção.

O Google também alertou sobre um tipo de malware chamado PROMPTSPY, que descreveu como uma mudança em direção a operações de ataque autônomas. O malware usa modelos de IA para interpretar estados do sistema e gerar comandos dinamicamente para manipular ambientes da vítima. Os invasores podem delegar decisões operacionais ao próprio modelo.

Os agentes maliciosos agora obtêm acesso anônimo de nível premium a modelos de linguagem por meio de middleware especializado e sistemas automatizados de registro de contas. Esses serviços permitem que os hackers contornem as restrições de uso em massa, utilizando contas de teste para financiar suas atividades.

Um grupo tracpelo Google como TeamPCP, também conhecido como UNC6780, começou a visar dependências de software de IA como ponto de entrada em redes mais amplas. Eles usam ferramentas de IA comprometidas como base para a implantação de ransomware e extorsão.

O Google afirmou que utiliza suas próprias ferramentas de IA para fins de segurança. A empresa mencionou o Big Sleep, um agente de IA que identificadentde software, e o CodeMender, que utiliza o raciocínio do Gemini paramaticcorrigir falhas

O Google também afirmou que desativa contas flagradas usando o Gemini para fins maliciosos.

Não se limite a ler notícias sobre criptomoedas. Compreenda-as. Assine nossa newsletter. É grátis.